从技术文档到算力落地:如何用 Markdown 超链接打通 AI 开发的“最后一公里”

在深度学习项目启动前,最让人头疼的往往不是模型设计,而是环境配置——CUDA 版本不匹配、cuDNN 缺失、PyTorch 安装失败……这些“非业务性问题”消耗了大量开发时间。尤其对新手而言,“为什么在我机器上跑不了”成了团队协作中的经典难题。

而如今,越来越多开发者选择跳过手动搭建环节,直接使用预配置的PyTorch-CUDA 容器镜像。这类镜像将框架、依赖和 GPU 支持打包成一个可移植单元,真正实现“拉取即运行”。但问题也随之而来:即使文档写得再详细,如果读者没有可用的 GPU 算力,一切仍停留在理论层面。

这时候,技术文档的角色就需要升级——它不该只是知识的传递者,更应成为行动的触发器。而实现这一跃迁的关键工具,正是我们每天都在用却常被低估的:Markdown 超链接。

设想这样一个场景:你在博客中介绍pytorch-cuda:v2.7镜像的强大功能,文末附上一句“你可以在支持 CUDA 的环境中运行此镜像”,还是直接嵌入一个带参数的购买链接,让用户点击后自动跳转到已预选该镜像的 A100 实例订购页?两者的转化效率天差地别。

这不仅仅是加个链接那么简单,而是一套完整的“认知→决策→执行”链路设计。我们将围绕PyTorch-CUDA-v2.7 镜像的实际应用,深入探讨如何通过轻量级的 Markdown 技术,把静态文档变成动态入口。

预置镜像为何能解决环境痛点?

传统方式下,搭建一个可用的 PyTorch + GPU 环境通常涉及以下步骤:

- 检查显卡驱动版本

- 安装对应版本的 CUDA Toolkit

- 安装 cuDNN 并设置环境变量

- 使用 pip 或 conda 安装与 CUDA 兼容的 PyTorch

- 测试torch.cuda.is_available()

每一步都可能因版本错配而失败。例如,PyTorch 2.7 官方推荐 CUDA 11.8 或 12.1,若系统安装的是 11.6,则无法启用 GPU 加速。

而容器化方案从根本上规避了这些问题。以pytorch-cuda:v2.7为例,它的核心机制在于:

docker run -d \ --name pytorch-dev \ --gpus all \ -p 8888:8888 \ -v ./notebooks:/workspace/notebooks \ registry.example.com/pytorch-cuda:v2.7这条命令背后隐藏着三层抽象:

1.操作系统层隔离:镜像自带精简版 Linux 系统,避免宿主机污染;

2.运行时一致性:Python、PyTorch、CUDA、cuDNN 版本全部锁定,确保“一次构建,处处运行”;

3.硬件访问代理:通过 NVIDIA Container Toolkit,容器可安全调用宿主机 GPU 资源,无需在容器内重复安装驱动。

这意味着,只要你的服务器或云实例装有 NVIDIA 显卡和基础驱动,就能一键启动完整训练环境。

验证是否成功也极为简单:

import torch print("CUDA Available:", torch.cuda.is_available()) # 应输出 True print("GPU Count:", torch.cuda.device_count()) print("Current GPU:", torch.cuda.get_device_name(0))如果看到类似 “NVIDIA A100-SXM4-40GB” 的输出,说明你已经拥有了可用于大规模训练的算力资源。

如何让文档不只是“看懂”,而是“用起来”?

很多技术文章止步于“教你怎么做”,却没解决“在哪做”的问题。特别是当本地设备不具备高性能 GPU 时,读者很容易陷入“知道方法但无法实践”的困境。

此时,文档的价值边界应当扩展:不仅要解释原理,还要提供通向资源的路径。而这正是Markdown 超链接的用武之地。

很多人认为超链接只是简单的文本跳转,但实际上,在精准设计下,它可以成为用户行为引导的核心组件。比如:

💡 **提示**:您可以通过以下链接快速申请搭载 A100 GPU 的云服务器,直接运行本镜像进行高性能训练: 👉 [立即体验 PyTorch-CUDA-v2.7(限时免费试用)](https://cloud.example.com/gpu?utm_source=blog&utm_medium=referral&utm_campaign=torch_cuda_v27)这个看似普通的链接,其实包含了多个策略考量:

-情绪引导:使用灯泡(💡)和箭头(👉)表情增强视觉吸引力;

-降低门槛:“限时免费试用”比“立即购买”更容易引发点击;

-数据追踪:UTM 参数可记录流量来源,评估内容营销效果;

-上下文关联:链接锚文本明确指向当前讨论的技术栈。

更进一步,还可以结合图片形成图文联动:

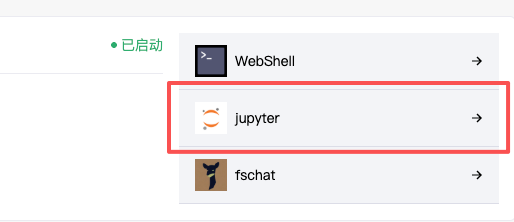

[](https://cloud.example.com/gpu/order?image=pytorch-cuda-v2.7)这张图可以是 Jupyter Notebook 中正在运行 ResNet 训练的画面截图。用户看到熟悉的界面,会产生“我也想这样操作”的代入感,从而提升点击意愿。更重要的是,目标页面可通过查询参数image=pytorch-cuda-v2.7自动预填镜像模板,减少用户选择成本。

构建“内容 → 行动”的闭环系统

理想的技术推广流程不应是单向输出,而应是一个闭环系统。我们可以将其拆解为以下几个关键节点:

graph LR A[技术博客 / 文档] --> B{嵌入超链接} B --> C[GPU 实例购买页] C --> D[自动部署镜像] D --> E[Jupyter/SSH 可用] E --> F[开始模型训练]在这个链条中,Markdown 超链接充当了从“知”到“行”的开关。它的优势在于无侵入性——不打断阅读节奏,又能在关键时刻提供出口。

实际落地时还需注意几个细节:

-位置选择:链接不宜出现在开头或中间突兀插入,最佳时机是在完成技术说明后的自然收尾处,如“现在就可以开始训练”之后。

-文案设计:避免使用“点击这里”这类模糊表述,改用行动导向语言,如“启动你的第一个 GPU 实例”或“导入镜像并开始调试”。

-移动端适配:确保链接在手机端清晰可点,图片链接尺寸建议不小于 200px 宽度。

-安全性控制:所有外链必须经过审核,优先使用 HTTPS,并考虑添加反钓鱼提示。

此外,对于企业级平台,还可结合用户身份做个性化推荐。例如,已登录用户点击链接后,直接跳转至其所属项目的资源创建页,并自动填充镜像版本、区域、规格等字段,进一步缩短操作路径。

为什么这种模式正在变得重要?

过去,技术文档的主要目标是“讲清楚”。但在 MLOps 和云原生加速普及的今天,文档本身也成为产品的一部分。尤其是面向开发者的服务平台,文档的质量不仅影响理解成本,更直接影响转化率。

我们观察到一种趋势:最好的 SDK 文档,本身就是最高效的获客渠道。AWS、Google Cloud、阿里云等平台早已采用“文档+一键部署”模式,用户在阅读教程的同时,就能直接启动对应的资源实例。

而对于中小型平台或开源项目维护者来说,利用 Markdown 超链接实现类似的引导机制,几乎是零成本的优化手段。不需要复杂的前端开发,也不依赖特定平台能力,仅靠标准语法即可完成高效引流。

更重要的是,这种方式保持了技术内容的专业性和可信度。相比于硬广横幅或弹窗广告,一个恰到好处的资源链接更像是“贴心助手”,帮助读者跨越从学习到实践的鸿沟。

当我们在撰写一篇关于 PyTorch-CUDA 镜像的技术文章时,真正的终点不应是“写完”,而是“有人因此跑起了代码”。而那个决定性的瞬间,可能就始于文档里一个不起眼的蓝色链接。

未来,随着 AI 工程化的深入,“内容即入口”将成为常态。无论是镜像分发、算力租赁,还是模型即服务(MaaS),都需要通过轻量、精准的方式触达用户。而 Markdown,这个诞生于极简主义时代的标记语言,正悄然承担起连接知识与行动的新使命。